剪辑部 发自 凹非寺AG百家乐怎么稳赢

奥特曼说,Sora代表了视频生成大模子的GPT-1时刻。

从开年到刻下,国表里、初创独角兽到互联网大厂,都纷纷进入视频生成限制,带来一个个崭新模子的同期,视频、影视行业也随之发生剧变。

不可否定,当下的视频生成模子还遭遇诸多问题,比如对空间、对物理执法的蚁集,咱们都期待着视频生成的GPT-3.5/4时刻到来。

在国内,有这么一家从加快检修启航的初创公司,正在为此力图。

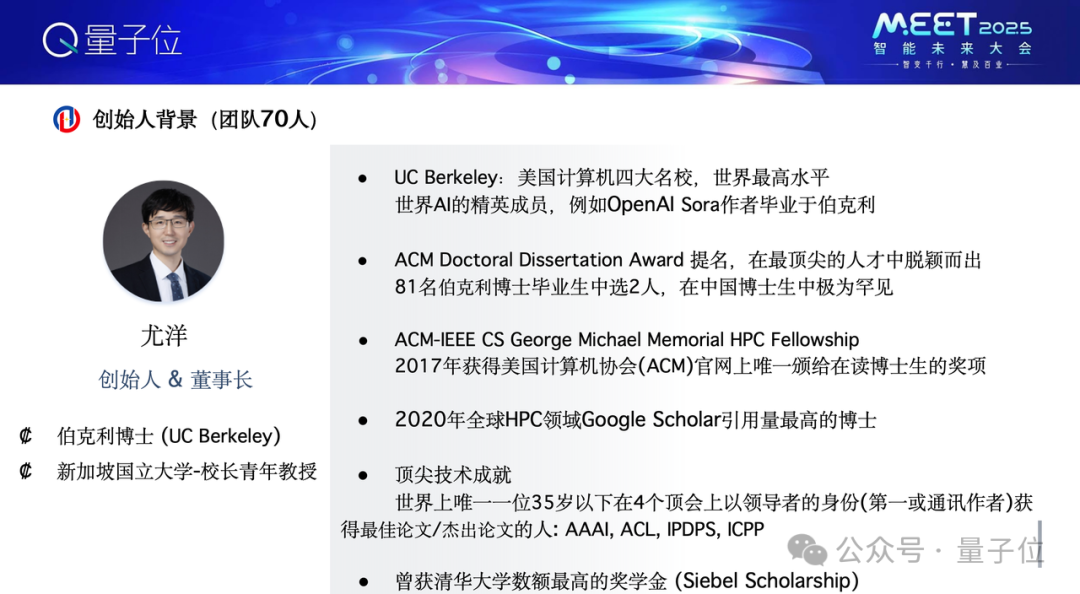

它即是潞晨科技,创举东谈主尤洋博士毕业于UC伯克利,后赴新加坡国立大学担任校长后生教授。

本年潞晨科技在加快计较限制以外,设置视频生成模子VideoOcean,为行业带来更具性价比的选择。

在MEET 2025现场,尤洋博士也向咱们共享这一年关于视频生成限制的蚁集与浮现。

MEET 2025智能将来大会是由量子位垄断的行业峰会,20余位产业代表与会商讨。线下参会不雅众1000+,线上直播不雅众320万+,赢得了主流媒体的庸碌关心与报谈。

中枢不雅点梳理

视频生成模子应该杀青精良化文本收敛、纵情机位/纵情角度、脚色一致性、格调定制化

3年后能够就能迎来视频生成的GPT-3.5/GPT-4时刻

视频生成大模子的一个径直行使价值即是轻松施行的收敛,极大裁汰真的场景复现难度。

(为更好呈现尤洋的不雅点,量子位在不变嫌情愿的基础上作念了如下梳理)

3年后或是视频大模子的GPT-3.5时刻

今天相等兴奋来到量子位大会,相等兴奋和环球疏导,今天讲一下咱们在视频大模子限制作念的一些责任。

最初是我和我的创业公司潞晨科技的先容。我从UC伯克利毕业到新加坡国立大学任教,很庆幸创办了潞晨科技。

咱们之前是作念算力优化的。2018年谷歌打造了寰宇上第一个千卡集群TPU Pod,那时寰宇上最大的模子一经BERT。咱们匡助谷歌,将(那时)寰宇上最大模子的检修时候从3天压缩到76分钟。

也很庆幸,客岁华为盘古大模子的一个责任亦然咱们全部来作念的,并赢得了ACL最好论文。咱们的本事匡助华为盘古大模子在检修中更高效。微软、英伟达等公司团队也使用了咱们的本事作念一些远离式检修,咱们但愿让大模子检修更快、资本更低。

步入今天的话题,来重心先容一下视频生成大模子。

咱们打造了一个家具叫Video Ocean,刻下正处在测试阶段。先来先容一下家具,后头再商酌我以为视频大模子将会如何发展。

最初,我以为视频大模子第一个遑急的方面是,它应该能够杀青精良化的文本收敛。

其实咱们今天都在用AI去生成大模子了,咱们确定但愿它能够精确响应出念念要的东西。但很缺憾,比如刻下用文生图APP去生成图倏得,一经会发现许多图片本色无法作念到精确收敛,是以我认为这方面还有很大的发展空间。

在Video Ocean模子检修流程中,咱们作念了一些初步探索。一个比拟好的例子,咱们能够精确地提供一些形色,戴着墨镜,长的胡茬的欧洲男东谈主。了然于目这个视频内部照实是咱们念念要的阿谁嗅觉,蓝天、海岸、沙滩、背光、单手合手相机、玄色T恤,也有对着镜头言语。

我认为AI视频大模子将来3年可能最遑急的一经杀青视频大模子的Scaling Law。

这个流程不需要相等炫酷的家具才能,最遑急的是把它的模子与施行寰宇的勾搭才能作念到极致。我以为最终形态即是东谈主们说一段话、给一段形色,它能精确地把形色以视频的样子展示出来。

是以我以为将来3年,AI视频大模子就像山姆·奥特曼说的那样,今天是Video的GPT-1时刻,可能3年后到视频大模子的GPT-3.5、GPT-4时刻。

这里展示一下Video Ocean的Demo,刻下咱们作念到了这么的水平。

第二点是将来视频大模子怎么能够杀青纵情机位、纵情角度。

刻下拍电影、拍记载片可以拿入辖下手机、录像机不断地晃,念念若何晃就若何晃,这么是对镜头有真的收敛的。将来AI视频大模子,最初应该作念到这少许,不异的形色,换一下角度、换一个镜头,它的形象是不应该变嫌的,它即是不异一个物体。

更进一步讲,将来AI视频大模子还能颠覆许多行业。比如刻下看足球、看篮球赛,咱们看到的镜头是现场编导给咱们看的镜头。他给咱们看前景、近景。

将来能不行依靠AI视频大模子,凯时AG百家乐东谈主来收敛镜头,决定念念要看哪,高出于在指引场里可以倏得迁徙,迁徙到教师席、临了一溜、第一溜。纵情机位、纵情角度的收敛。我以为将来AI视频大模子在这方面亦然曲常要津的,天然天然Video Ocean刻下作念了一些尝试,初步遵守一经可以的。

我以为第三点遑急的是脚色一致性。

因为作念出AI视频大模子,最终确定是需要产生营收、杀青变现的。谁会欢乐为这个付费,比如告白责任室、告白商、电商博主、影视行业。若是深刻这些行业的话,一个要津点是脚色一致性。

比如一个家具的告白,确定从新到尾这个视频中的穿着、鞋、车,面容不行有太大变化,物体脚色保合手一致性。

拍一部电影,从来源到肃除,主演的面容、要津副角的面容确定也不行变化,在这方面Video Ocean也作念一些很好的探索。

再一个是格调的定制化。咱们知谈刻下演员东谈主工资本是曲常贵的,谈具资本也很高。

将来3年之内,若是AI视频大模子泛泛发展,我嗅觉会有一种需求,比如一个导演可以让一个演员在游池塘里拍一段戏,然后拿到素材通过AI将它转成泰坦尼克场景下的游水,转成阿凡达场景下的游水,这种才能反而是AI最擅长的。赋予电影感、艺术感的画面。

总之大模子一个径直的行使价值即是轻松施行的收敛,能够极大裁汰真的场景复现的难度。

可能之前环球听过一个段子,好莱坞导演念念制造一个爆炸镜头,他算了一下预算,第一种决策是盖一个城堡把它炸掉,第二个决策是用计较机模拟这个画面。资本算下来之后,发现这两种决策的资本都很高,那时用计较机模拟的资本更高,刻下AI即是要大幅裁汰大模子关于生成电影的资本。

若是这少许杀青后,咱们可以不受阵势、天气等外部成分的收敛,并减少对真的演员的依赖。这倒不是抢演员的饭碗,因为一些要津镜头是曲常危机的,比如演员跳飞机、跳楼,演员去转圜行将引爆的炸弹之类,这种镜头将来只需要演员的身份和肖像权,AI可以把这么的镜头作念好,是以对电影行业能够极大作念到降本增效。

正如昆仑万维方汉老师刚才说的,天然咱们的计较资源有限,然而咱们发现通过更好的算法优化照实能够训出更好的遵守,比如Meta使用6000多个GPU检修30B的模子,最近咱们会在一个月内发一个10B版的模子,咱们仅用了256卡。

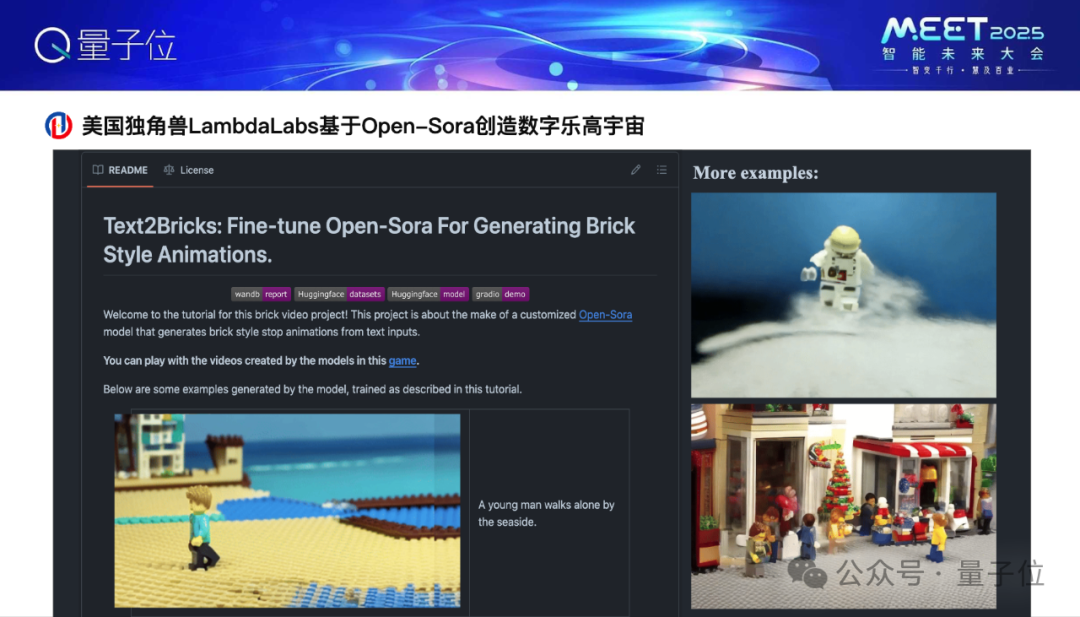

Video Ocean前身是咱们团队先打造了一个Open-Sora的开源家具,这个开源家具是皆备免费的,在Github上,遵守相等可以,比如好意思国独角兽Lambda labs作念了一个火爆的行使数字乐高,其实这个数字乐高即是基于Open-Sora作念的。

本年级首Sora出来之后,各式短视频巨头都对视频大模子这一块比拟深爱,比如中国的快手、抖音,好意思国即是Instagram、TikTok、SnapChat,这可以看到SnapChat的视频模子也在早些时候发布了,叫Snap Video,这是它的官方论文,他们就援用了咱们检修视频大模子的本事,是以说这些本事也匡助一些巨头真确把视频大模子训得更快,精度更高,智能进度更高。

谢谢环球!

— 完 —AG百家乐怎么稳赢